ОГЛАВЛЕНИЕ:

- Вступление. Архитектура GK110, новые возможности GeForce GTX TITAN.

- Ускоритель ZOTAC GeForce GTX TITAN. Внешний вид и особенности аппаратного оснащения.

- Нагрев, уровень шума. Пара слов о необходимости разгона. Тесты.

Ещё несколько месяцев назад на страницах зарубежных новостных ресурсов стали появляться скудные данные о некоем мифическом 3D ускорителе от компании NVIDIA. Судя по первым слухам, которые, впоследствии подтвердились, новая видеокарта должна была получить гордое имя “TITAN”, а её сердцем должен был стать супермощный GPU с архитектурой Kepler. Скептики не верили в существование Титана, поклонники же, отнюдь, всем сердцем ждали новинку и пророчили флагманской графике AMD поражение в борьбе с зелёным монстром. Так бы и продолжались словесные перепалки, если бы, наконец, не произошёл долгожданный анонс, после которого все смогли оценить способности новоиспечённого одночипового флагмана. Ну а я, в свою очередь, после того, как эмоциональный накал от выхода GeForce GTX TITAN немного спал, хочу спокойно и без спешки посмотреть на производительность ускорителя GeForce GTX TITAN в самых современных играх вроде Tomb Raider и Crysis 3. Сделаю я это не так как большинство журналистов, поскольку в отличие от многих в нашей тестовой лаборатории используется платформа AMD.

Прежде всего, как мне кажется, нужно разобраться с архитектурой графического процессора GeForce GTX TITAN. Начнём.

Знаю наверняка, от чего не умрут маркетологи NVIDIA. От скромности :) Новый ускоритель GeForce GTX TITAN зовётся основой для игрового суперкомпьютера. Звучит, конечно, красиво, однако так можно назвать, пожалуй, любую игровую станцию на базе одной или нескольких флагманских видеокарт, по крайней мере, на стадии анонса или сразу после него. Впрочем, не буду придираться, продолжу.

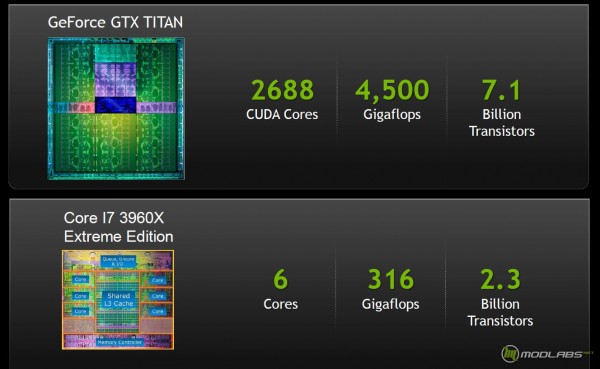

Осознание способностей графического процессора GeForce GTX TITAN, лучше всего приходить после выставления точки отсчёта. В данном случае ей стал один из экстремальных процессоров Intel – Core i7 3960X Extreme Edition. По сравнению с этим чипом, GPU TITAN, действительно, является суперкомпьютером, жаль только, что вся эта вычислительная мощь актуальна для игроков лишь при наличии маленького кусочка кремния от Intel или AMD....

Чтобы понять, откуда растут ноги, и благодаря чему удалось достичь столь впечатляющих вычислительных показателей, нужно немного углубиться в историю и покопаться в архитектуре GPU ускорителя GeForce GTX TITAN. Дело в том, что после анонса графических ускорителей поколения Kepler, стало ясно, что GeForce GTX 680 не состоялся как флагман в полном смысле этого слова. Этот ускоритель использовал GPU GK104, который, по своей топологии оказался больше похож на Middle-High продукт, нежели на флагманское решение. Чтобы убедится в этом, посмотрите на устройство чипов GF110 и GF114 на базе Fermi, поймёте о чём я. Судя по всему, технологические проблемы не позволили NVIDIA в разумные сроки наладить массовый выпуск полноценных GK110 и, чтобы даром время не терять, был найден компромисс. В общем-то, NVIDIA этого факта и не скрывала, GeForce GTX 680 был временным игроком, который должен был получить более мощного преемника как только удастся решить проблемы с 28-нм техпроцессом. Впрочем, при кажущейся простоте, GeForce GTX 680 обладал отличной производительностью и довольно неплохими характеристиками энергопотребления и тепловыделения. Теперь, с выпуском графического ускорителя GeForce GTX TITAN инженеры компании подвели некоторую технологическую черту, за которую одночиповые решения NVIDIA вряд ли выйдут в рамках архитектуры Kepler, поскольку настольная версия GK110 получила практически все заложенные в неё возможности.

Графический процессор GK110 содержит блок управления потоками, именуемый GigaThread Enginе, кеш память для инструкций и данных, контроллеры памяти, блоки растровых операций, а также Graphics Processing Clusters (GPC), который выполняет вычислительные операции и операции с текстурами. В составе GK110 находятся пять блоков GPC. Внутри каждого GPC, в свою очередь, находится по одному движку растеризации, а также по три так называемых SMX (SM – в терминологии NVIDIA для GPU Tesla и Fermi) - потоковых мультипроцессора. В отличие от серверного Tesla K20/K20X, в составе которых трудится полноценная версия GK110 с 15-ю активными блоками SMX, настольный графический чип GK110 получил лишь 14 активных потоковых мультипроцессора. Количество текстурных блоков равно 224, а блоков растеризации – 48.

В составе SMX трудятся 224 текстурных блока и 48 ROP (блоков растеризации), особого рассмотрения заслуживают блоки операций с двойной точностью. Общее количество блоков FP64 (те самые блоки операций с двойной точностью) составляет 896 штук, по 64 на каждый SMX, – это положительное отличие от GK104. Не очень хорошо то, что по умолчанию, ядра, предназначенные для работы с FP64, работают на 1/8 от частоты других блоков, размещённых в SMX. Правда стоит отметить, что в драйверах есть возможность поднять тактовую частоту FP64 блоков, переключив видеокарту в режим “CUDA двойная точность”, однако общая тактовая частота GPU снизится. Вот что получилось при запуске 3D приложения после включения вышеозначенной опции (значения Temp Target было сдвинуто до 90 градусов Цельсия):

Отключаем режим двойной точности, получаем:

Так вот, поскольку суммарное количество ядер CUDA в GK110 равно 2688 (по 192 штуки на один блок SMX), а количество FP64 блоков – 896, получаем, что соотношение FP64/FP32 блоков = 1/3. Если вспомнить, что FP64 блоки работают на 1/8 частоты GPU, получим, что эффективность выполнения операций с двойной точностью составляет 1/24 от FP32! Да, да, близкая ситуация в FP64 операциях была и у GeForce GTX 680, из за столь же низкой эффективности таких вычислений он “сливал” старине GTX 580. Вот только в данном случае низкая эффективность при работе с FP64 компенсируется за счёт колоссального увеличения количества самих вычислительных блоков. У AMD, кстати, при переходе к FP64 провал заметно меньше, скорость падает примерно вдвое. Это, конечно, на словах звучит страшно, на практике же, применительно к играм, всё не так плохо, скорее даже очень хорошо, поскольку архитектура Fermi, а теперь и Kepler имеет не так много слабых мест и решения на её основе более чем конкурентоспособны.

Контроллер памяти у GK110 заметно подтянут относительно оного у GK104, теперь он 384 битный, против 256 битного, а суммарный объём локальной видеопамяти GeForce GTX TITAN составляет 6144 Мбайт = 6 Гбайт! Здесь полный порядок.

В итоге мы получаем, что настольная версия видеокарт, базирующихся на GPU GK110, обладает следующими характеристиками.

Ещё пару лет назад, снимок экрана с окном программы GPU-Z, отображающей характеристики GeForce TITAN, сочли бы как минимум поддельными, а как максимум, назвали бы автора этих снимков сумасшедшим. Нынче же ситуация иная, перед нами настоящий Титан, по крайней мере по формальным характеристикам. Согласитесь, тактовые частоты GPU 837/876 МГц, частота видеопамяти 6008 МГц, шина памяти 384 бит (ПСП памяти 288 Гбайт/с), 48 блоков растеризации и 224 текстурных блока, 2688 ядер CUDA и всё это при использовании 7,1 млрд. транзисторов! Даже сейчас это выглядит круто, при этом TDP платы GeForce GTX TITAN не пугает современного пользователя – всего 250 Вт.

Если по части архитектуры GPU и подсистемы памяти мы разобрались, то оверклокерские характеристики ещё требуют описания. Уж поверьте, есть на что обратить внимание. Эти данные, определённо, нужно будет учитывать при подходе к разгону.

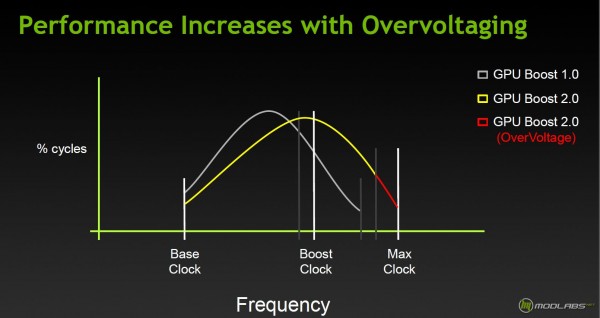

Динамический разгон. Технология NVIDIA GPU Boost ver. 2.0

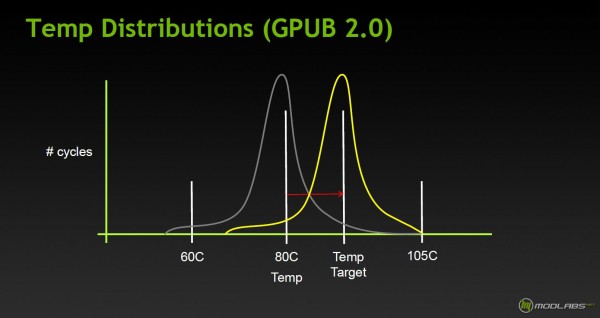

Итак, первая версия технологии форсирования частоты GPU от NVIDIA в своей работе учитывала только один параметр – предел мощности/напряжение GPU, который изменялся в определённых рамках. Сейчас же появился ещё один фактор – предельная температура, при которой GPU в состоянии функционировать без сбоев.

По умолчанию значение предельной температуры выставлено на уровень 80 градусов Цельсия, однако пользователь вручную может изменить этот уровень до 94 градусов. Такое смещение позволит работать графическому процессору под нагрузкой при более высоких частотах. Судя по слайдам с презентации, именно рабочая температура GPU будет решающим фактором в достижении максимальной частоты при работе GPU Boost 2.0.

На практике при разгоне видеокарты мы будем выставлять не только значение Power Target, но и Temperature Target. Кстати, отмечу, что в технической документации от NVIDIA написано о возможности регулировки напряжения как об опции, которая может быть выключена производителем посредствам VBIOS. Думаю, что вряд ли кто-то будет намеренно глушить эту возможность.

Одной из интересных возможностей ускорителей NVIDIA является технология адаптивной вертикальной синхронизации, суть которой заключается в нивелирование эффекта “разрыва кадра” и “подёргиваний“ картинки при резком изменении частоты смены кадров. Новизна Adaptive V-sync в случае с GeForce GTX TITAN заключается в том, что отныне ограничение частоты смены кадров при адаптивной вертикальной синхронизации можно увеличить до 120 Гц включительно.

Напоследок, хочу вспомнить о технологии NVIDIA SLI. Не секрет, что максимальное количество одновременно задействованных GPU в системе с видеокартами NVIDIA может достигать четырёх. Пара GeForce GTX 690 – отличный пример работы 4-Way SLI. Использование такого тандема, как мне кажется, оправдано довольно редко, поскольку помимо ограничений в вычислительной мощи центрального процессора, остро стоит проблема синхронизации четырёх чипов для работы над картинкой. Коэффициент полезного действия 4-Way SLI систем существенно ниже, чем у, скажем, 2-Way или 3-Way SLI. Зная об этом, NVIDIA с выходом GeForce TITAN активно продвигает тему 3-Way SLI, как самую оптимальную с точки зрения эффективности и самую высокопроизводительную. На мой взгляд, такое позиционирование оправдывает себя, особенно для видеосистемы класса TITAN. Вот только крайне рекомендую для “Титановых” SLI связок обзавестись мощнейшим процессором, да ещё и разогнать его.

На этом я заканчиваю теоретическую часть материала, пришла пора знакомиться с Титаном лично.

.png)

.jpg)

.jpg)